Datos, privacidad, biometría vs. FaceAppChallenge

22 julio, 2019

Aplicaciones como FaceApp y sus retos virales ponen en peligro la privacidad de nuestros datos.

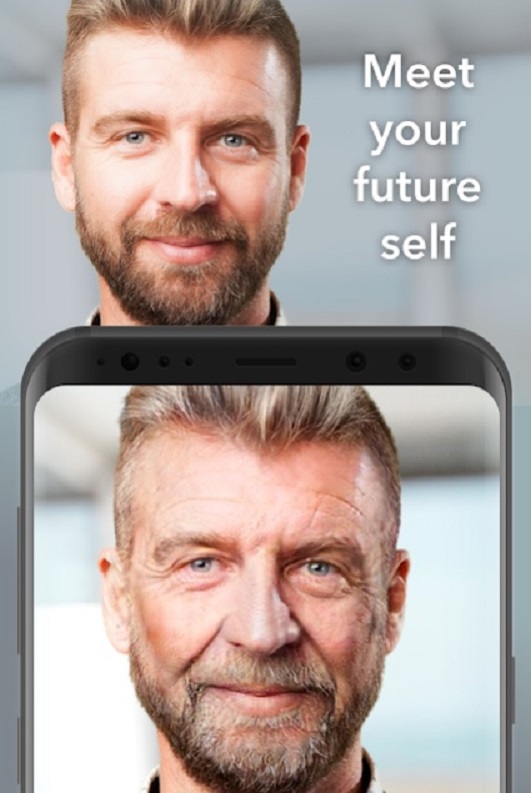

Quién en los últimos días no ha visto una foto de un amigo, conocido o saludado compartiendo en Facebook, Instagram o Twitter una foto como si fuera una persona de 60 o 70 años, participando en lo que se ha llamado #FaceAppChallange? Estamos ante la explosión de una nueva app viral, FaceApp, una aplicación creada por Wireless Lab, una empresa con sede en San Petesburgo, Rusia, que gracias a la inteligencia artificial te transporta a tu yo del futuro.

La viralidad de este tipo de aplicaciones, que se difunden rápidamente a través de la redes sociales y en las cuales contribuyen con su participación famosos y deportistas, conllevan que la mayoría de usuarios hagan uso de la aplicación sin tener en cuenta las implicaciones y riesgos que el uso de este tipo de apps con condiciones de privacidad algo ambiguas, acarrean para la privacidad de sus usuarios, y del uso que se hagan de los datos obtenidos.

Cesión de datos y privacidad

La experta de la UOC en protección de datos y privacidad, profesora del Grado de Derecho y directora del Posgrado en Protección de Datos, Mònica Vilasau, señala que el principal riesgo de este tipo de aplicaciones es el gran número de datos que obtienen. No solo se trata de los datos que cedemos conscientemente, como las fotos o la dirección de correo electrónico, sino otros de los que no somos conscientes. Concretamente se trata de los datos de navegación o bien los datos de ubicación, que pueden revelar información sensible, por ejemplo, si nos hallamos en un lugar de culto, en una clínica de rehabilitación o en la sede de un partido político. Además este tipo de aplicaciones (como indica la política de privacidad de FaceApp), declara que cede los datos a empresas del grupo, sin identificar exactamente los posibles destinatarios.

El principal riesgo de este tipo de aplicaciones es el gran número de datos que obtienen. No solo se trata de los datos que cedemos conscientemente, como las fotos o la dirección de correo electrónico, sino otros de los que no somos conscientes

Esta ingente cantidad de datos permite, entre otras cosas, llevar a cabo perfiles de los afectados y enviar publicidad personalizada.

En definitiva, una vez se han subido los datos se pierde el control de los mismos porque se diluyen en la red y se desconocen las ulteriores transmisiones que se llevan a cabo de los mismos. Sin embargo, debe subrayarse que estos no son riesgos exclusivos de FaceApp sino que pueden predicarse de cualquier tipo de aplicación. Si bien la normativa (el RGPD) señala que este es aplicable a todos aquellos que ofrezcan bienes y servicios a interesados que residan en la UE, el problema es cómo exigir el cumplimiento de la normativa más allá de las fronteras de la UE.

Biometría, herramienta de la criminología

Así mismo, también se ha apuntado que la proliferación de este tipo de apps basados en el reconocimiento facial tienen como fin último nutrir las bases de datos de empresas tecnológicas con el objetivo de entrenar algoritmos de reconocimiento facial. No en vano, como apuntaba el criminólogo, profesor del Grado de Criminología y del nuevo Máster en Ciberdelincuencia de la UOC, Marc Balcells, en el apunte publicado en este mismo blog, Big Data e Inteligencia Artificial como frentes de la lucha contra la ciberdelincuencia, la criminología cada vez más recurre al Big Data y a la Inteligencia Artificial para detectar el perfil del posible futuro delincuente. En plena época estival, muchas personas estarán viajando a sus destinos vacacionales: para muchos, uno de los requisitos de acceso a los diferentes estados a los que viajen será la cesión de sus datos biométricos. Las fuerzas de seguridad recogen estos datos en forma de fotografía, toma de huellas dactilares y demás modalidades. Estos datos han devenido una necesidad después de diversos ataques terroristas que han hecho cambiar las tornas en el llamado binomio seguridad-libertades individuales.

La biometría es una herramienta con muchas implicaciones en el control y la prevención del delito, que tradicionalmente ha sido utilizada por parte de diferentes agencias estatales. El problema es cuando estos datos devienen moneda de cambio entre empresas privadas y qué usos quieren dar estas empresas a nuestros datos biométricos

Dejando de lado cómo cada uno de nosotros nos sentimos hacia el uso que se les da a estas medidas y su injerencia en nuestra privacidad, la biometría es una herramienta con muchas implicaciones en el control y la prevención del delito, que tradicionalmente ha sido utilizada por parte de diferentes agencias estatales. El problema es cuando estos datos devienen moneda de cambio entre empresas privadas y qué usos quieren dar estas empresas a nuestros datos biométricos. Un ejemplo de ‘buen’ uso es el llevado a cabo por Apple, que con el slogan de la seguridad por delante, nos indica que gracias a nuestra huella dactilar o nuestros rasgos faciales, nuestros dispositivos son más seguros que con un simple código de cuatro cifras. Pero la cesión de datos biométricos a una empresa por el simple hecho de verse envejecido o rejuvenecido ya es harina de otro costal, puesto que se pierde el control sobre estos datos, por una finalidad poco más que espúrea. No sabemos para qué serán usados nuestros datos, y por lo tanto, ello nos debe hacer pensar, y mucho: no puede ser que para un servicio tan poco útil entreguemos todos nuestros ‘secretos’ a una empresa privada.